Posté le 22 novembre 2020

Par Yohann Goyat

Par Yohann Goyat

Daniel Jean est producteur chez Moment Factory. Firme montréalaise qui officie dans les arts numériques et visuels depuis dix-neuf ans. Dernièrement il a travaillé avec son équipe à la réalisation le 24 octobre dernier du livestream « Where do we go » de Billie Eilish. Un concert cent pour cent virtuel et en réalité augmentée (XR) tourné dans les studios à Los Angeles avec, à leurs côtés, l'équipe de XR Studios. Un projet très ambitieux pour une grande première mondiale. Il nous explique comment tout cela a été possible.

La tournée originale Where Do We Go de Billie Eilish ayant été annulée, il leur fallait trouver une alternative. « Ce livestream était une solution pour reconnecter avec son auditoire », dit-il. Moment Factory était en tournée avec elle lorsque la pandémie les a contraints a tout arrêter brusquement. « L'idée du live streaming en réalité augmentée (Extended Reality) est venue de Billie qui s'est tournée vers nous en nous demandant : « Qu'est ce que vous en savez, de quoi êtes-vous capables? » »

Un ambitieux challenge

Pour passer d'une version live à une version streaming en réalité augmentée, il a fallu à Daniel Jean et son équipe revoir tout un tas de paramètres. Les possibilités sont multiples en post-production, cependant « nous avons dû revoir toutes les chansons et les visuels associés à chacune d'entre elles. L'idée était de les bonifier, les mettre en valeur et rendre l'effet encore plus réaliste », précise-t-il.

Un projet énorme non sans risque puisque l'on parle là d'un show d'une durée de 55 minutes (13 chansons) en réalité augmentée en version live streaming. Une première mondiale dans le genre pour Moment Factory car « c'était très risqué et la marge d'erreur que nous avions était quasi nulle. Chaque position des caméras, chaque contenu étaient positionnés au millimètre près. Nous n'avions pas le droit à l'erreur! » Avant d'ajouter avec un grand sourire : « Un projet ambitieux que nous avons relevé haut la main et dont nous sommes très fiers. »

Un processus technique au cordeau

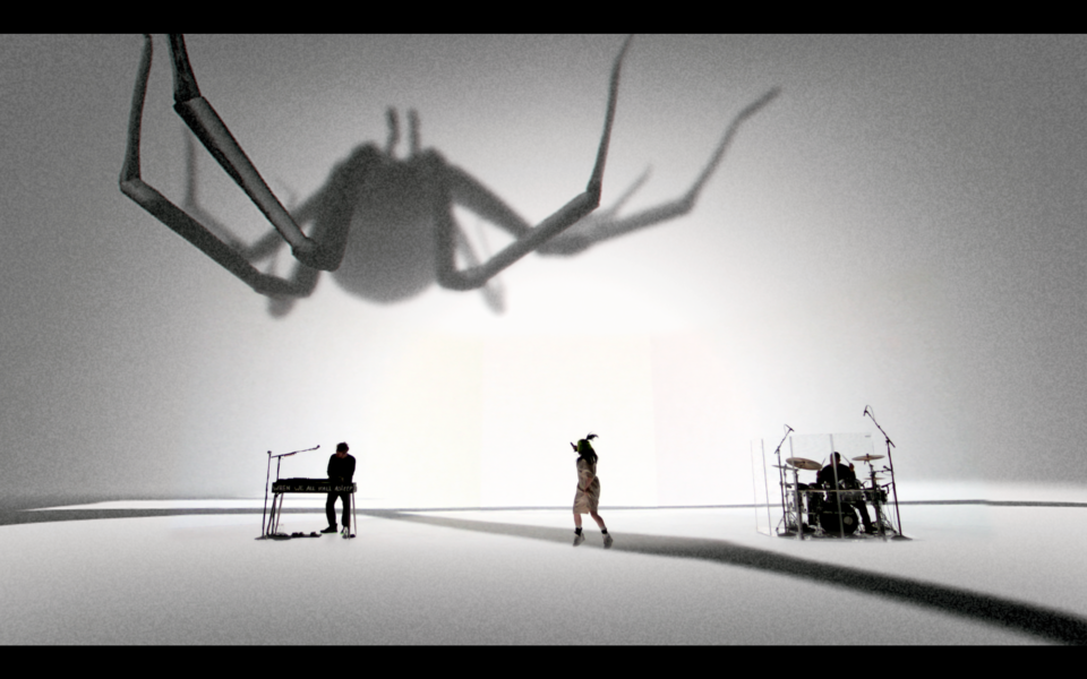

La logistique c'est une chose, la technique et la mise en place des supports en sont une autre. « On parle là d'une scène de trente pieds par soixante. Imaginez-vous un grand écran LED en arrière scène et un au plancher. Entre douze et quinze caméras qui captent chaque mouvement, toutes synchronisées avec le contenu visuel dont la caméra principale est axée sur Billie », explique Daniel Jean avant d'ajouter : « Et pour chaque mouvement de caméra, le contenu visuel va bouger aussi de la même manière, ce qui donne tous les effets de profondeur. » C'est ainsi que la perception de l'araignée géante a été un succès et aussi vraie que nature.

Mais le processus utilisé pour la réalisation de « réalité augmentée » réside dans la superposition d'images, appelée aussi « foreground » plus une extension à même le cadre. « En résumé, nous avons l'image au sol, l'image à l'arrière et il est possible de rajouter une image en avant du cadre. Et en plus de ça, il est possible de rajouter une image au cadre entier », explique-t-il.

Pousser les limites toujours plus loin

Tout comme Billie Eilish, pousser les limites au maximum est dans l'ADN de Moment Factory depuis ses débuts. Toujours aller plus loin dans l'expérimentation des nouvelles technologiques, Daniel Jean l'assure : « En post-production on peut tout faire, on peut pousser assez loin comme avec le motion capture et créer un univers très poussé ». En ces temps-ci d'isolation sociale, l'aspect live est quelque chose que les gens ont besoin de ressentir. « Voilà pourquoi le XR est très intéressant à ce niveau-là, et il va le rester », ajoute-t-il.

Cependant cette technologie a ses limites sociales « et rien ne vaut un concert tous ensemble » soupire t-il. En termes d'avancées technologiques, aujourd'hui la réalité virtuelle nous ferme au monde et la réalité augmentée est une lentille transparente qui permet d'avoir cet ajout d'image dans un environnement contrôlé. Depuis cinq ans, le sujet est sur la table, mais très complexe puisque les produits qui existent sont imposants. « Pour autant d'ici une dizaine d'années on pourrait très bien s'imaginer aller à un concert avec une scène, des artistes et que tout ce qui est jeux de lumière et interactivités se passent à travers la lentille du spectateur », conclut Daniel Jean avec un grand sourire.

Un ambitieux challenge

Pour passer d'une version live à une version streaming en réalité augmentée, il a fallu à Daniel Jean et son équipe revoir tout un tas de paramètres. Les possibilités sont multiples en post-production, cependant « nous avons dû revoir toutes les chansons et les visuels associés à chacune d'entre elles. L'idée était de les bonifier, les mettre en valeur et rendre l'effet encore plus réaliste », précise-t-il.

Un projet énorme non sans risque puisque l'on parle là d'un show d'une durée de 55 minutes (13 chansons) en réalité augmentée en version live streaming. Une première mondiale dans le genre pour Moment Factory car « c'était très risqué et la marge d'erreur que nous avions était quasi nulle. Chaque position des caméras, chaque contenu étaient positionnés au millimètre près. Nous n'avions pas le droit à l'erreur! » Avant d'ajouter avec un grand sourire : « Un projet ambitieux que nous avons relevé haut la main et dont nous sommes très fiers. »

Un processus technique au cordeau

La logistique c'est une chose, la technique et la mise en place des supports en sont une autre. « On parle là d'une scène de trente pieds par soixante. Imaginez-vous un grand écran LED en arrière scène et un au plancher. Entre douze et quinze caméras qui captent chaque mouvement, toutes synchronisées avec le contenu visuel dont la caméra principale est axée sur Billie », explique Daniel Jean avant d'ajouter : « Et pour chaque mouvement de caméra, le contenu visuel va bouger aussi de la même manière, ce qui donne tous les effets de profondeur. » C'est ainsi que la perception de l'araignée géante a été un succès et aussi vraie que nature.

Mais le processus utilisé pour la réalisation de « réalité augmentée » réside dans la superposition d'images, appelée aussi « foreground » plus une extension à même le cadre. « En résumé, nous avons l'image au sol, l'image à l'arrière et il est possible de rajouter une image en avant du cadre. Et en plus de ça, il est possible de rajouter une image au cadre entier », explique-t-il.

Pousser les limites toujours plus loin

Tout comme Billie Eilish, pousser les limites au maximum est dans l'ADN de Moment Factory depuis ses débuts. Toujours aller plus loin dans l'expérimentation des nouvelles technologiques, Daniel Jean l'assure : « En post-production on peut tout faire, on peut pousser assez loin comme avec le motion capture et créer un univers très poussé ». En ces temps-ci d'isolation sociale, l'aspect live est quelque chose que les gens ont besoin de ressentir. « Voilà pourquoi le XR est très intéressant à ce niveau-là, et il va le rester », ajoute-t-il.

Cependant cette technologie a ses limites sociales « et rien ne vaut un concert tous ensemble » soupire t-il. En termes d'avancées technologiques, aujourd'hui la réalité virtuelle nous ferme au monde et la réalité augmentée est une lentille transparente qui permet d'avoir cet ajout d'image dans un environnement contrôlé. Depuis cinq ans, le sujet est sur la table, mais très complexe puisque les produits qui existent sont imposants. « Pour autant d'ici une dizaine d'années on pourrait très bien s'imaginer aller à un concert avec une scène, des artistes et que tout ce qui est jeux de lumière et interactivités se passent à travers la lentille du spectateur », conclut Daniel Jean avec un grand sourire.